自然言語処理AI

LLMを活用した業務効率化、RAGによる社内ナレッジ活用、 カスタマーサポートの自動化など、言語AIソリューションを提供します。

自然言語処理(NLP: Natural Language Processing)は、 人間が日常的に使用する言語(テキスト・音声)をコンピュータで解析・生成する技術です。 ChatGPTを始めとする大規模言語モデル(LLM)の登場により、 自然言語処理AIは飛躍的な進化を遂げ、ビジネス活用の可能性が大きく広がりました。

従来は専門家でなければ難しかった高度な言語タスク——文書作成、翻訳、要約、質問応答、コード生成——が、 LLMによって誰でも手軽に実現できるようになりました。 しかし、LLMを実業務に効果的に組み込むためには、 プロンプト設計、ファインチューニング、RAGによる知識拡張、セキュリティ対策など、 専門的なノウハウが必要です。

弊社では、OpenAI、Anthropic、Google、オープンソースLLM(Llama、Mistralなど)を活用し、 お客様の業務に最適化された自然言語処理ソリューションを提供しています。

主な活用シーン

社内ナレッジ検索

社内文書・マニュアルを自然言語で検索・質問応答

カスタマーサポート

FAQ自動応答、問い合わせ分類・ルーティング

文書作成支援

レポート、メール、契約書のドラフト生成

議事録・要約

会議録の自動要約、アクションアイテム抽出

データ抽出・分析

請求書、契約書からの情報抽出(IDP)

コード生成・レビュー

開発効率化、コード品質向上

LLMアプリケーション開発

LLMを業務システムに組み込むには、単にAPIを呼び出すだけでは不十分です。 LangChainやLlamaIndexなどのフレームワークを活用し、 複数のLLMやツールを連携させた高度なアプリケーションを構築します。

対応LLMプロバイダー

LLMアプリケーションの主な機能

- • エージェント:LLMが自律的にツールを選択・実行

- • チェーン:複数のLLM呼び出しを連結した複雑なワークフロー

- • メモリ:会話履歴の保持、長期記憶の管理

- • ツール連携:外部API、データベース、検索エンジンとの統合

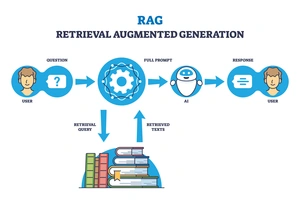

RAG(検索拡張生成)

RAG(Retrieval Augmented Generation)は、 LLMに外部の知識ベースを参照させることで、回答の精度と信頼性を向上させる技術です。 LLMの学習データに含まれない最新情報や社内固有の情報に基づいた回答が可能になります。

RAGで解決できる課題

- • ハルシネーション防止:根拠となる文書を参照し、事実に基づいた回答を生成

- • 最新情報への対応:学習データのカットオフ日以降の情報も利用可能

- • 社内知識の活用:マニュアル、FAQ、過去の問い合わせ履歴を参照

- • 出典の明示:回答の根拠となった文書を提示し、信頼性を担保

RAGシステム構築のポイント

- • ベクトルDB:Pinecone、Weaviate、pgvectorなどによる高速検索

- • チャンキング:文書を適切なサイズに分割し、検索精度を向上

- • リランキング:検索結果の関連度を再評価

- • ハイブリッド検索:キーワード検索とベクトル検索の組み合わせ

自然言語処理AIの導入をお考えですか?

お問い合わせ