コンピュータビジョン開発の標準:OpenMMLab 2.0で実現する高度な物体検出と姿勢推定(MMDetection & MMPose)

木村 優志

Published: 2/19/2026, 8:33:00 AM

AIによる画像解析の世界は、日々新しい論文が発表され、その進化のスピードは驚異的です。最新のモデルを自社のプロジェクトに取り入れようとした際、「論文のコードベースがバラバラで環境構築に時間がかかる」「共通のインターフェースがないため、モデルの入れ替えが困難」といった課題に直面したことはないでしょうか?

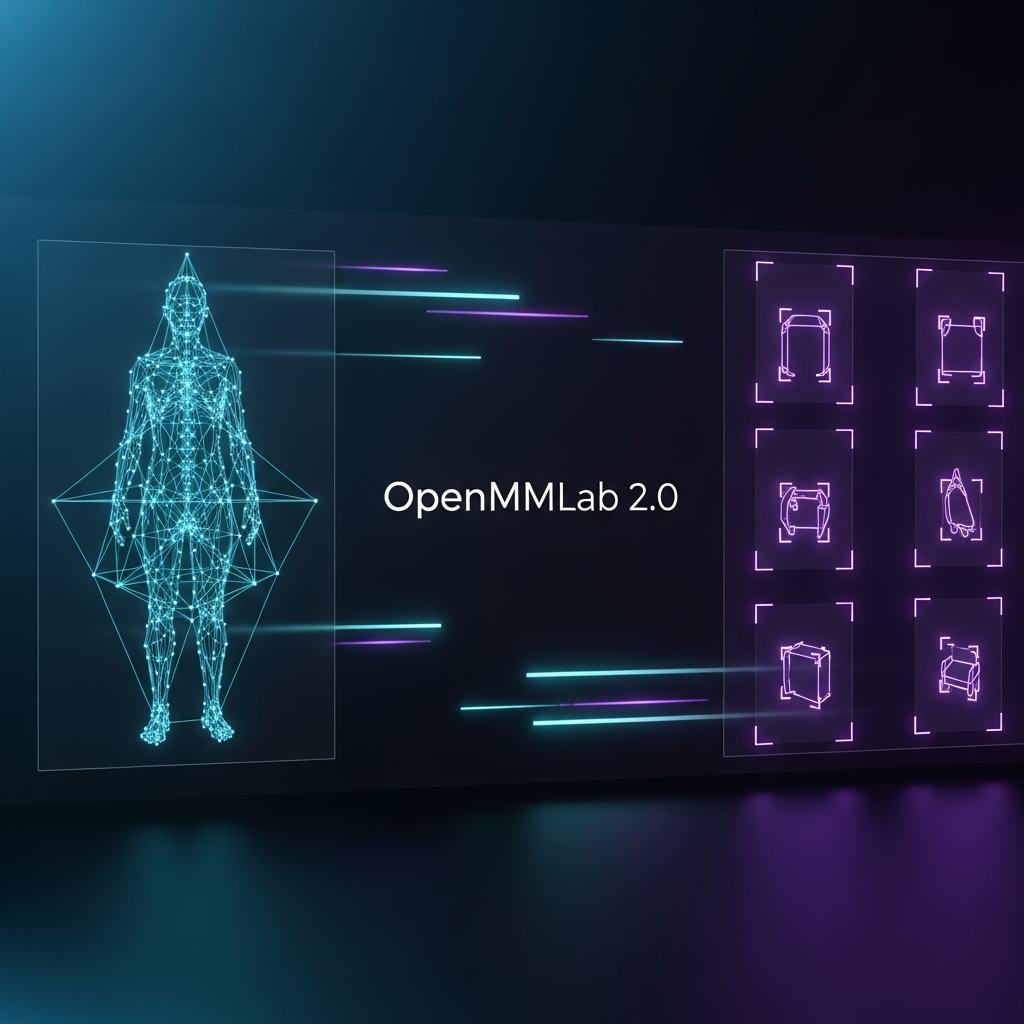

こうした開発現場の「摩擦」を解消し、研究から実用化までを最短距離で結ぶ強力なエコシステムがOpenMMLabです。今回は、その中でも中核をなすMMDetection(物体検出)とMMPose(姿勢推定)の最新動向(v3.x / v1.x)を深掘りして解説します。

1. なぜ今、OpenMMLab 2.0なのか?

OpenMMLabは、2023年に基盤を刷新した「2.0」へと完全移行しました。このアップデートの最大の目玉は、共通基盤であるMMEngineの導入です。

統一された「作法」が開発効率を変える

従来のライブラリ群は個別に最適化されていましたが、2.0では以下のプロセスが全てのタスクで共通化されました。

- データの読み込み(Dataset & DataLoader)

- モデルの構築(Model Architecture)

- 学習・評価プロセス(Runner & Hook)

これにより、例えば「MMDetectionで物体検出を学んだエンジニア」が、翌日から全く同じ感覚で「MMPoseによる姿勢推定」や「MMSegmentationによる領域分割」の開発に着手できるようになりました。この学習コストの低減は、チーム開発において計り知れないメリットをもたらします。

2. 物体検出の「辞書」:MMDetection (v3.x)

MMDetectionは、物体検出のあらゆるニーズに応えるツールボックスです。単なるアルゴリズムの寄せ集めではなく、コンポーネント(Backbone, Neck, Head)を自由に組み替えられる柔軟性が特徴です。

2.1. 注目すべき最新モデルと機能

- Grounding DINO (Open-Vocabulary Detection):

従来の物体検出は、学習時に定義したクラス(例:犬、猫)しか見つけられませんでした。しかし、Grounding DINOの統合により、「青いネクタイをした男性」といったテキスト指示(プロンプト)だけで、未学習の物体を即座に検出可能になりました。 - RTMDet (Real-time Models):

OpenMMLabが独自に開発したリアルタイム検出器です。YOLOシリーズに匹敵する速度を維持しつつ、より少ないパラメータ数で高い精度を実現しており、ドローンや工場内の監視カメラなどのエッジデバイスへの実装に最適です。 - Multi-task 学習:

物体検出、インスタンスセグメンテーション、パノプティックセグメンテーションを一つのフレームワークで切り替え可能。用途に合わせて最適な粒度を選択できます。

3. 動作をデジタル化する:MMPose (v1.x)

MMPoseは、人や動物の「骨格(キーポイント)」を特定する技術に特化しています。1.x系へのアップデートにより、速度と表現力が飛躍的に向上しました。

3.1. 133点のキーポイントによる「全身推定」

従来の姿勢推定(COCO形式など)は、主要な関節17点のみを追跡するのが一般的でした。MMPose 1.xでは、以下の全身(Whole-body)133点を一度に高精度で推定可能です。

- 体(Body): 主要な関節(肩、腰、膝など)

- 手(Hands): 指の関節(片手21点×2)

- 顔(Face): 目、鼻、口の輪郭や表情

- 足(Feet): つま先やかかとの動き

これにより、手話の認識、表情による感情分析、微細なリハビリ動作の記録など、これまでは困難だった領域への応用が可能になりました。

3.2. リアルタイム・姿勢推定の革命:RTMPose & RTMO

- RTMPose: 従来のHRNetなどは精度が高い反面、計算量が膨大でした。RTMPoseは、モバイルデバイス上でも30fps以上のリアルタイム動作を実現しながら、トップクラスの精度を維持しています。

- RTMO (Real-Time One-stage): これまでの姿勢推定は「まず人を検出し、次に骨格を推定する」という2段階(Top-down方式)が主流でしたが、RTMOは直接骨格を推定する1段階(One-stage)方式を採用。推論のレイテンシを極限まで抑えることができます。

4. 導入からデプロイまでのワークフロー

OpenMMLabを採用すると、開発フローが非常にシンプルになります。

- Configの継承:

_base_ ファイルを継承することで、わずか数十行の設定ファイルを書くだけで、最新の論文手法を自社データに適用できます。 - データの共通化:

独自のデータセットを一度「COCOフォーマット」などに変換してしまえば、全てのOpenMMLabライブラリでそのまま使い回せます。 - MMDeployによる最適化:

学習したモデルは、MMDeployを通じてTensorRTやOpenVINO、ONNXなどへ即座に変換可能。サーバー、PC、エッジ端末、どこへでもシームレスにデプロイできます。

5. 具体的な活用シナリオ

- 製造業:

RTMDetによる外観検査と、MMPoseによる作業員の動線・作業負荷分析を組み合わせたスマート工場の実現。 - ヘルスケア・スポーツ:

Whole-body推定による歩行分析や、スポーツフォームの自動フィードバックシステムの構築。 - セキュリティ:

Grounding DINOを活用した、特定の不審行動や持ち物の検知(「ヘルメットを被っていない人」「刃物を持っている人」など)。

最後に:Convergence Labにお任せください

OpenMMLabは非常に強力なツールですが、その多機能さゆえに、最適なモデルの選定やハイパーパラメータの調整、エッジデバイスへの最適化には高度な専門知識が必要です。

Convergence Labでは、OpenMMLabを活用した画像認識システムの受託開発から、既存ワークフローへのAI導入コンサルティングまで幅広くサポートしています。「この動作を数値化したい」「この物体を自動で見つけたい」といった課題をお持ちの方は、ぜひお気軽にお問い合わせください。

関連記事(あわせて読みたい)

参考リンク: